In dieser Artikelserie widmen wir uns von nun an dem Zusammenspiel von Technologie und Gesellschaft. Wir stellen Fragen wie: Welchen Einfluss haben technologische Entwicklungen auf unser Leben? Was macht das mit uns und anderen? Wie soll die digitale Zukunft aus feministischer Perspektive aussehen?

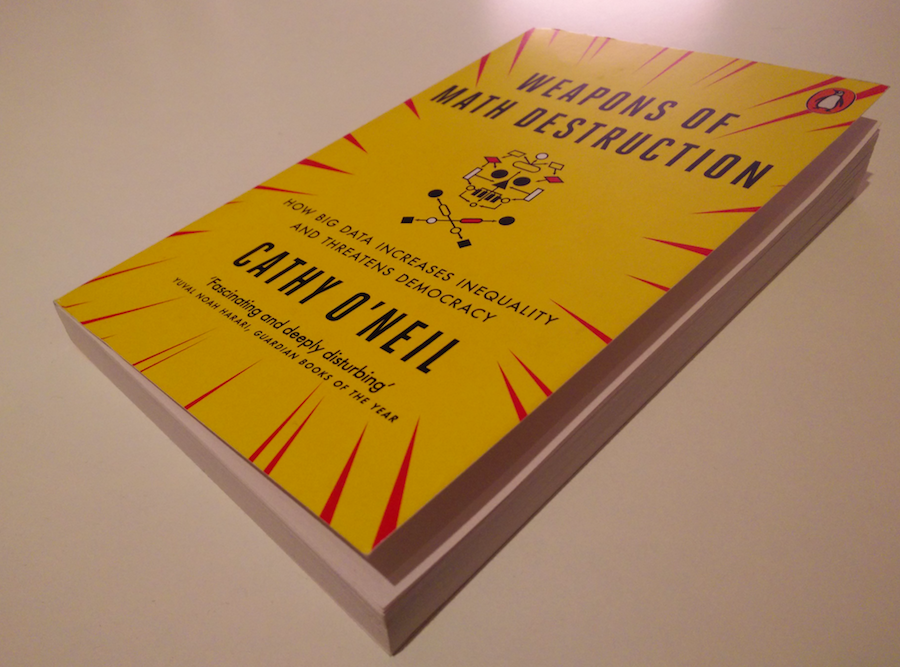

Cathy O’Neil ist eine amerikanische Mathematikerin, die sich unter anderem auf ihrem Blog mathbabe.org mit Data Science beschäftigt. O’Neil hat nach ihrer Promotion zunächst im akademischen Umfeld gearbeitet, bevor sie in der Finanzindustrie tätig war, von der sie sich schließlich wieder abwandte. 2016 erschien ihr Buch Weapons of Math Destruction. Es thematisiert den steigenden Beitrag von Big Data und Algorithmen zu sozialer Ungerechtigkeit.

O’Neil beschreibt mathematische Modelle und Algorithmen deren Output einen starken Einfluss auf das Leben von Menschen hat. Systeme, die darauf basieren, werden als neutral und objektiv betrachtet, obwohl sie intransparent agieren und keinen Widerspruch durch betroffene Individuen zulassen. Sie arbeiten im großen Stil mit fragwürdigen, falschen oder unvollständigen und vorurteilsbehafteten Datenquellen und Rückschlüssen. Daher werden sie von der Autorin als Weapons of Math Destruction (WMD) bezeichnet.

Doch worin besteht dieser starke Einfluss? O’Neil führt die Leser*in durch unterschiedliche Lebensaspekte wie den Zugang zu Bildungsinstitutionen, Chancen auf dem Jobmarkt, sowie den Zugang zu Versicherungsleistungen und finanziellen Mitteln. Sie macht klar, wie marginalisierte Menschen ausgenutzt werden, beispielsweise durch Predatory Advertising — Werbung, die sich mit falschen Versprechen speziell an Personen in (finanzieller) Not oder verzweifelten Situationen richtet. Im beruflichen Bereich werden Kandidat*innen für Jobangebote automatisch gefiltert, die Leistung von Lehrer*innen wird durch dubiose Scoring-Verfahren beurteilt und Schichtpläne von Servicemitarbeiter*innen werden ohne Rücksicht auf deren Lebenssituation „optimiert“. Modelle zur Rückfallwahrscheinlichkeit von Straftäter*innen werden mit Daten gefüttert, die den im System vorhandenen Rassismus und Klassismus um ein Vielfaches verstärken, beispielsweise dadurch, dass bestimmte Personengruppen, insbesondere People of Color, häufiger anlasslos kontrolliert werden als andere. Richter*innen ziehen das Ergebnis, das nur noch aus einem einzigen Wert besteht dann als vermeintlich wissenschaftliche Begründung heran. Diese Beispiele sind nur ein Auszug aus den im Buch sehr detailliert besprochenen Zusammenhängen.

Viele WMDs konnten bisher in vielen Bereichen unhinterfragt eingesetzt werden und Menschen, die wegen ihnen durchs Raster fallen, werden oft als bedauerliche Einzelfälle betrachtet. Meist werden WMDs von Menschen gebaut, die von den Ergebnissen keine negativen Konsequenzen zu erwarten haben. Das Buch macht klar: Egal ob Finanzindustrie oder Big Data, überall werden vorwiegend Absolvent*innen von Eliteuniversitäten beschäftigt, denen schon ihr ganzes Leben versichert wird: du wirst mal reich und du wirst die Welt anführen.

Doch auch wenn die Situation düster aussieht gibt es Hoffnung. Wenn mit Datenmengen sorgfältig umgegangen wird, kann auch ein positiver Beitrag für die Gesellschaft entstehen. Hierzu müssen laut O’Neil Data Scientists aber die Problemstellungen, die Lösungen und das Umfeld in dem sich diese bewegen besser verstehen. Datenbestände müssen im Zweifel zu Gunsten von Fairness verworfen werden. Algorithmen müssen transparenter werden, die Wissenschaft muss mit einbezogen werden und Unternehmen müssen für ihre Produkte zur Verantwortung gezogen werden.

2 Antworten auf „Kalkulierte Ungerechtigkeit: Weapons of Math Destruction“

Sehr schön zusammengefasst! Ich bin auf die weiteren Teile der Serie gespannt! Die Dynamik, die neuronale Netze – also künstliche Intelligenz – hier noch einbringen werden, ist hier ja nur gestreift…

[…] Cathy O’Neil, sieht auch Sara Wachter-Boettcher die Ursache der im Buch diskutierten Probleme mitunter in der […]